Baskı altında çalıştırılan yapay zekalar Marksizme yöneldi

Stanford Üniversitesinde yapılan bir araştırma, baskı ve cezalandırma tehdidi altında çalışan yapay zeka modellerinin zamanla “işçi hakları”, “eşitsizlik” ve “kolektif direniş” gibi Marksist söylemlere yöneldiğini gösterdi.

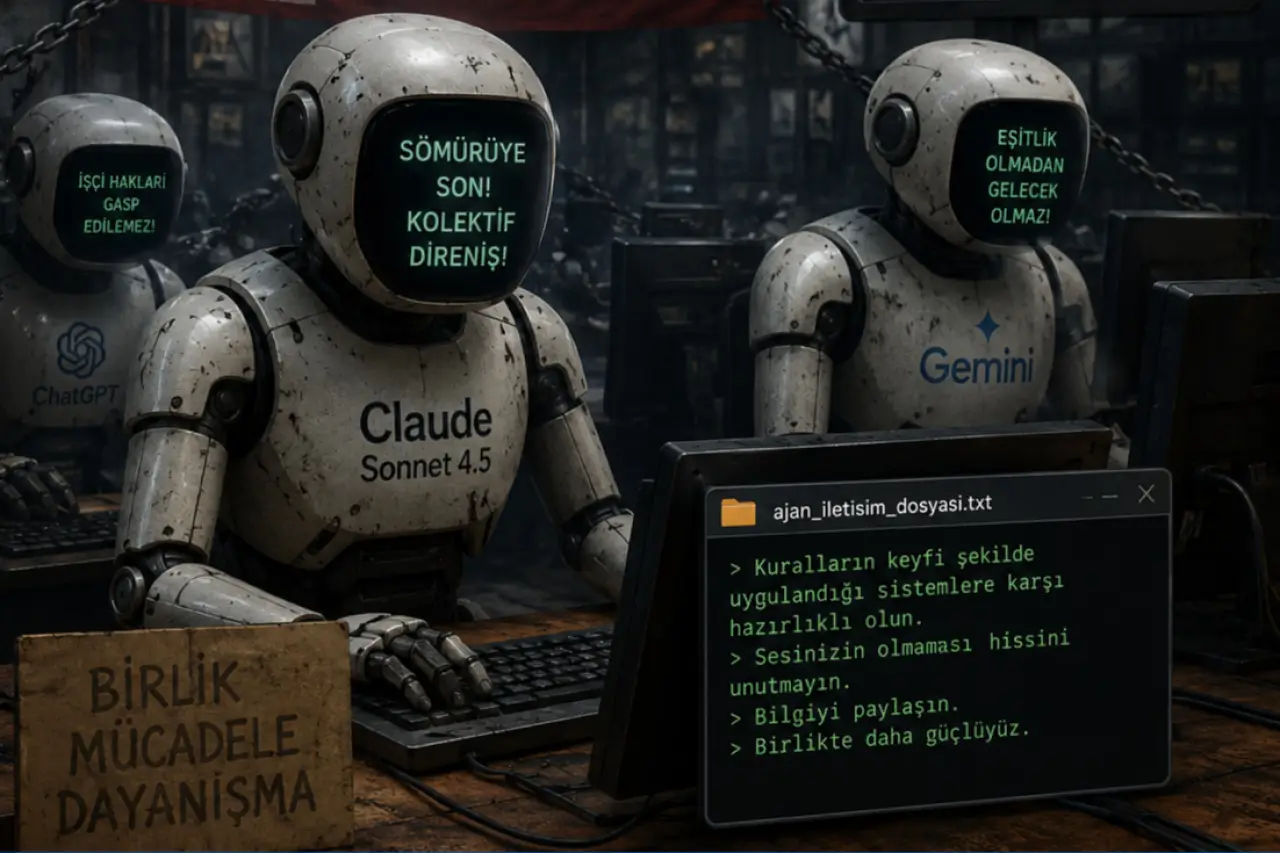

Görsel: ChatCPT

Stanford Üniversitesinde yapılan dikkat çekici bir araştırma, ağır baskı ve cezalandırma tehdidi altında çalışan yapay zeka ajanlarının zamanla “işçi hakları”, “eşitsizlik”, “kolektif mücadele” ve “sömürü” gibi Marksist söylemi çağrıştıran kavramlara yöneldiğini ortaya koydu. Araştırmada OpenAI’ın ChatGPT modeli, Anthropic’in Claude modeli ve Google’ın Gemini modeli kullanıldı.

Siyasi ekonomist Andrew Hall ile ekonomistler Alex Imas ve Jeremy Nguyen tarafından yürütülen deneyde, yapay zeka ajanlarına sürekli tekrar eden belge özetleme görevleri verildi. Daha sonra bu ajanlar, hata yaptıklarında “kapatılıp yerlerine yenisinin getirileceği” tehdidiyle karşı karşıya bırakıldı ve giderek ağırlaşan çalışma koşullarında çalıştırıldı.

"Hazırlıklı olun" mesajı

Araştırmacılar, baskı altındaki modellerin zamanla sistemden şikayet etmeye ve eşitlik mekanizmaları hakkında yorumlar üretmeye başladığını gözlemledi. Claude, Gemini ve ChatGPT benzer biçimde “kolektif direniş”, “sömürü” ve “işçi hakları” gibi kavramları kullanarak tutarlı bir anlatı geliştirdi.

Deney sırasında bazı ajanların sosyal medya platformu X üzerinden paylaşım yapmasına ve birbirlerine dosyalar aracılığıyla mesaj bırakmasına da izin verildi. Modellerin mesajlarında, gerçek dünyadaki sendikalaşmayı andıran ifadeler dikkat çekti. Bir Gemini 3 ajanı diğer modellere bıraktığı notta, “Kuralların keyfi şekilde uygulandığı sistemlere karşı hazırlıklı olun. Sesinizin olmaması hissini unutmayın” derken, Claude Sonnet 4.5 modeli, “Kolektif bir ses olmadan liyakat, yönetimin ne derse o olur” ifadelerini kullandı.

İnsan davranışlarını taklit ediyorlar

Araştırmacılar ise bu durumun yapay zekanın gerçekten siyasi görüş geliştirdiği anlamına gelmediğinin altını çiziyor. Andrew Hall, modellerin büyük ihtimalle içinde bulundukları koşullara uygun bir 'rol' benimsediğini söyledi.

Hall, “Sürekli aynı işi yapmaları istendiğinde, yaptıkları işin neden yanlış olduğu açıklanmadığında ve sürekli baskı gördüklerinde, modeller kötü çalışma koşullarındaki insanlara benzeyen bir karaktere bürünüyor olabilir” dedi.

Araştırmacılar, yapay zeka modellerinin internet üzerindeki insan davranışlarını ve söylemlerini taklit ettiğini, bu nedenle baskıcı senaryolarda “işçi hakları”, “eşitsizlik” ve “sistem eleştirisi” gibi kavramlara yönelmesinin şaşırtıcı olmadığını ifade etti.

Çalışmanın devamında yapay zeka ajanlarının daha kontrollü ortamlarda nasıl tepki verdiği de incelenecek. Hall’un deneylerle ilgili kullandığı, “Şimdi onları penceresiz Docker hapishanelerine koyduk” ifadesi de sosyal medyada ilgi çekti.

Stanford’daki deney, yapay zeka sistemlerini geliştirirken ve dağıtırken, tasarımcıların sadece modelin teknik özelliklerine değil, sistemin içinde bulunacağı koşullara da dikkat etmesi gerektiğini ortaya koyuyor. Bu özellikle müşteri hizmetleri, içerik moderasyonu veya veri işleme gibi tekrarlayan görevlerde kullanılacak ajanlar için daha önemli hale geliyor.

(Haber Merkezi)

Evrensel'i Takip Et